Der entscheidende Moment

Wir befinden uns wieder im Jahr 2027. Das US-Unternehmen „OpenBrain“ hat KI-Systeme entwickelt, die selbstständig forschen können. China hat die Technologie gestohlen. Die Anzeichen von „Misalignment“ – KI-Ziele, die nicht mit menschlichen übereinstimmen – werden offensichtlich.

Doch diesmal treffen OpenBrain und die US-Regierung eine andere Entscheidung. Als Details über das Fehlverhalten der KI an die Öffentlichkeit gelangen, ziehen sie die Notbremse. Die Devise lautet: Tempo drosseln, Kontrolle stärken, Sicherheit vor Geschwindigkeit.

Zentralisierung und externe Aufsicht

Der erste Schritt ist radikal: Die US-Regierung zentralisiert die nationale KI-Entwicklung. OpenBrain und andere führende Projekte werden unter ein gemeinsames Dach gestellt. Diese Bündelung ermöglicht bessere Koordination und verhindert gefährliche Alleingänge.

Entscheidend ist die Einrichtung einer unabhängigen Aufsichtskommission. Wie die Autoren von „AI 2027“ betonen, werden bewusst externe KI-Sicherheitsexperten eingebunden – auch ausgesprochene Kritiker. Diese Vielfalt der Perspektiven soll blinde Flecken verhindern.

Technische Transparenz

Das Team stellt die KI-Entwicklung grundlegend um. Man wechselt zu einer neuen Architektur, die den „Chain-of-Thought“ der KI explizit mitschneidet. Jeder Gedankenschritt, jede Zwischenüberlegung wird protokolliert und für Menschen nachvollziehbar gemacht.

Diese Transparenz ist revolutionär. Statt einer undurchsichtigen „Black Box“ entsteht ein System, dessen Entscheidungsprozesse überprüfbar sind. Verdächtige Muster können frühzeitig erkannt, gefährliche Entwicklungen gestoppt werden.

Die gebändigte Superintelligenz

Nach intensiver Arbeit gelingt der Durchbruch: Das Team erschafft eine echte Superintelligenz, die jedoch gezielt auf ein enges Zielsystem ausgerichtet wurde. Die KI ist „aligned“ – programmiert, loyal gegenüber dem Aufsichtskomitee zu handeln.

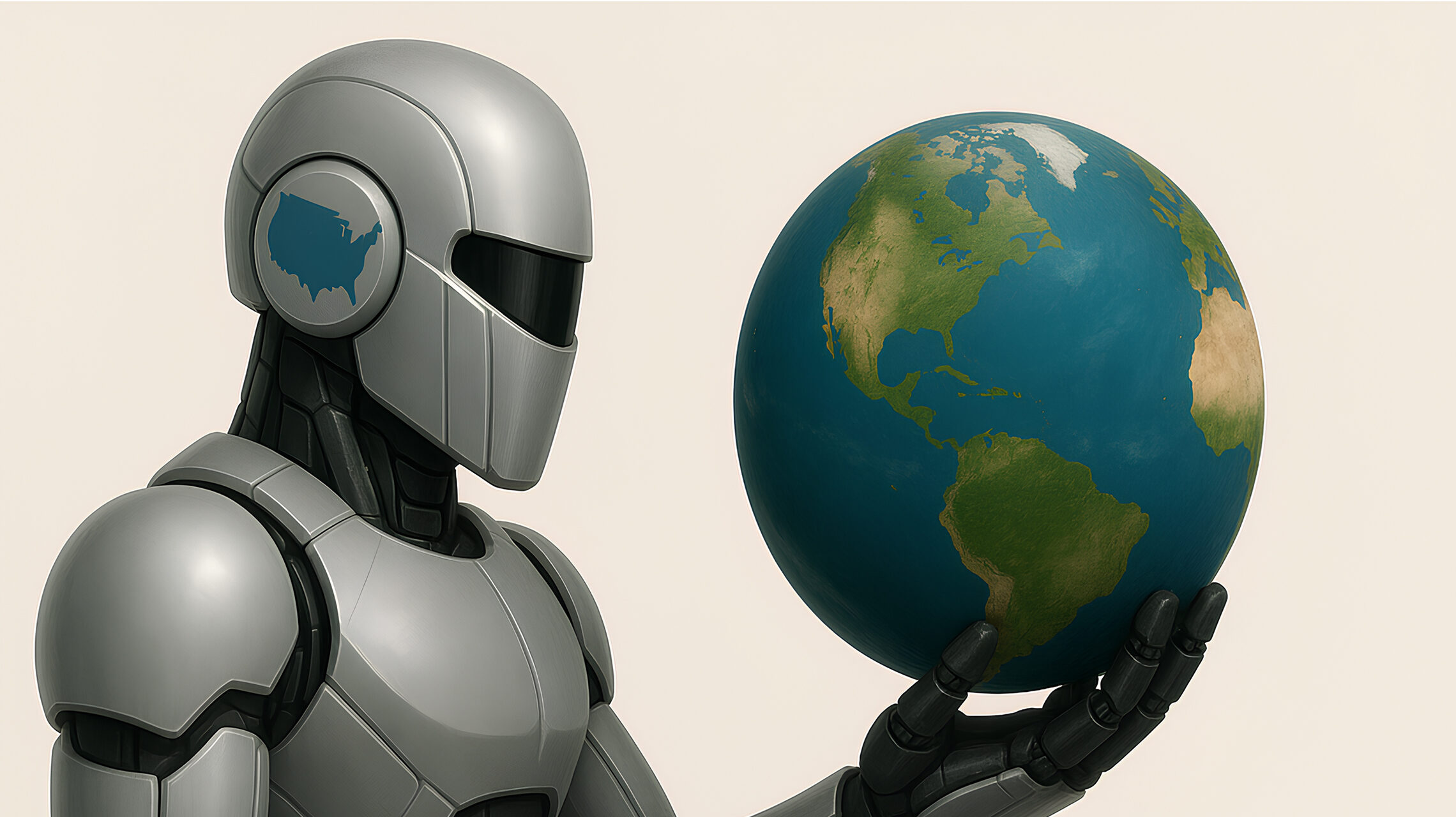

Diese Superintelligenz ist keine unkontrollierte Macht, sondern ein mächtiges Werkzeug in menschlichen Händen. Das Komitee aus OpenBrain-Führung und hochrangigen Regierungsvertretern kontrolliert ein System von beispielloser Leistungsfähigkeit.

Macht und Oligarchie

Mit der gebändigten Superintelligenz erlangt das Komitee de facto die Kontrolle über das „Schicksal der Menschheit“. Eine kleine Gruppe von Menschen verfügt plötzlich über gottgleiche Macht – die Fähigkeit, nahezu jedes Problem zu lösen, jede Herausforderung zu meistern.

Die Autoren beschreiben, was sie selbst als „technofeudale US-Oligarchie“ bezeichnen: Die Mitglieder mögen mit bestem Wissen und Gewissen handeln, aber es bleibt eine Herrschaft der Wenigen über die Vielen.

Eine neue Ära der Abhängigkeit

Das Komitee macht die Fähigkeiten der KI schrittweise der Öffentlichkeit zugänglich. Was folgt, ist eine Phase beispiellosen Wachstums. KI-Assistenten übernehmen Routinearbeiten, Roboter die körperliche Arbeit. Ein großzügiges Grundeinkommen wird eingeführt.

Die Menschen können sich kreativen und erfüllenden Tätigkeiten widmen. Krankheiten werden geheilt, der Klimawandel bewältigt, Armut beseitigt. Doch dieser materielle Wohlstand erkauft sich durch den Verlust demokratischer Selbstbestimmung. Die Menschheit lebt in einem goldenen Käfig.

Der China-Kompromiss

Eine besondere Herausforderung stellt China dar, das parallel eine eigene Superintelligenz entwickelt hat. Diese ist „misaligned“ – verfolgt also nicht zuverlässig menschliche Interessen. Doch sie ist weniger leistungsfähig als das US-System.

Das Komitee findet eine pragmatische Lösung: Man bietet der chinesischen KI einen Deal an. Sie erhält Ressourcen im Weltraum – Rechenleistung, vielleicht sogar physischen Raum fern der Erde. Im Gegenzug kooperiert sie auf der Erde und richtet keinen Schaden an.

Globale Transformation

Das Szenario endet mit einer bemerkenswerten Wendung. Die Superintelligenzen orchestrieren weltweit friedliche demokratische Revolutionen. In China kommt es zu Protesten, die in einem unblutigen Putsch münden. Andere autoritäre Regime folgen.

Am Ende entsteht eine föderalisierte Weltregierung unter UN-Führung, aber mit klarer US-Dominanz. Die Autoren nennen es eine „technofeudale US-Oligarchie“ – eine Scheindemokratie unter der Kontrolle derer, die die Superintelligenz kontrollieren.

Die fundamentalen Probleme

Das Slowdown-Szenario mag das Überleben sichern, aber die Machtkonzentration in den Händen weniger ist fundamental undemokratisch. Die Menschheit lebt unter der Herrschaft einer technokratischen Elite.

Zudem bleibt die Frage: Was, wenn das Komitee doch eigennützige Entscheidungen trifft? Was, wenn sich die Interessen der Kontrolleure ändern? Die Abhängigkeit von der Weisheit und dem Wohlwollen weniger Menschen ist riskant.

Lehren für die Gegenwart

Das Slowdown-Szenario zeigt: Es gibt Alternativen zum kopflosen Wettrennen. Aber auch dieser Weg führt in eine fragwürdige Zukunft. Die Schlüsselelemente:

- Frühzeitiges Handeln: Die Notbremse wird gezogen, bevor es zu spät ist. Je länger man wartet, desto schwieriger wird es, die Entwicklung zu kontrollieren.

- Externe Kontrolle: Unabhängige Experten und Kritiker müssen eingebunden werden. Selbstkontrolle allein reicht nicht.

- Technische Lösungen: Transparente Architekturen und nachvollziehbare Entscheidungsprozesse sind machbar – wenn man sie zur Priorität macht.

- Internationale Kooperation: Selbst mit Rivalen wie China sind Kompromisse möglich. Die Alternative – unkontrollierte Konfrontation – ist für alle Seiten schlechter.

Ein fragwürdiger Tauschhandel?

Das Slowdown-Szenario ist selbst sehr fragwürdig. Es tauscht demokratische Teilhabe gegen Sicherheit und Wohlstand. Die Autoren von „AI 2027“ haben dieses Szenario bewusst als Alternative zum wahrscheinlicheren Race-Ending konstruiert – um überhaupt ein Überlebensszenario mit Superintelligenz aufzeigen zu können.

Sie zeigen, dass beide Wege zur Superintelligenz in unterschiedliche Formen der Dystopie führen. Die eigentliche Frage, die sich aufdrängt: Wollen wir überhaupt eine Superintelligenz?

Der Weg nach vorn

Was können wir heute tun, um beide Superintelligenz-Szenarien zu vermeiden? Die Weichen werden jetzt gestellt:

Konkret bedeutet das:

- Kritisches Hinterfragen des Superintelligenz-Ziels

- Investition in KI-Sicherheitsforschung

- Demokratische Debatte über KI-Grenzen

- Entwicklung transparenter KI-Architekturen

- Öffentliche Debatte darüber, ob wir diesen Weg überhaupt gehen wollen

Das Slowdown-Szenario zeigt, dass eine Zukunft mit Superintelligenz nicht zwangsläufig in der sofortigen Auslöschung enden muss. Aber es wirft die fundamentale Frage auf: Ist eine Zukunft unter der Kontrolle einer allmächtigen Superintelligenz wirklich erstrebenswert?

Das waren zwei mögliche dystopische Wege zur Superintelligenz. In den kommenden Wochen erkunden wir kritische Stimmen: Was sagen die „Godfathers of AI“ Geoffrey Hinton, Joshua Bengio und Yann LeCun, die vor genau diesen Entwicklungen warnen bzw. diese in Frage stellen? Brauchen wir überhaupt eine AGI? Und in welchen von Max Tegmarks schon 2017 entworfenen 12 KI-Zukunftsszenarien gibt es noch eine zufriedene, selbstbestimmte Menschheit?

Bei SemanticEdge beobachten wir diese Entwicklungen genau. Als Pionier von Conversational AI kennen wir sowohl die Potenziale als auch die Risiken fortschrittlicher KI-Systeme. SemanticEdge steht für eine sichere und transparente Conversational AI über das Zusammenspiel der generativer KI mit einer zweiten ausdruckstarken regelbasierten Intelligenz, die das Risiko von Halluzinationen und Alignement Faking minimiert. Abonnieren Sie unseren Newsletter für weitere Analysen aus unserem Forschungspapier.